Stellen Sie sich einen Moment vor, dass das Schlüsselelement Ihres Erfolgs plötzlich der ganzen Welt offenbart wird. Genau das ist die Situation, in der sich Anthropic befindet, ein einst diskretes Unternehmen, das heute aufgrund eines Code-Lecks im Rampenlicht steht. Wie könnte ein solches Ereignis die Zukunft der künstlichen Intelligenz und der daraus resultierenden Technologien beeinflussen? Entdecken Sie, wie dieser Umbruch die aktuelle technologische Landschaft neu definieren könnte.

Die 3 wichtigsten Informationen

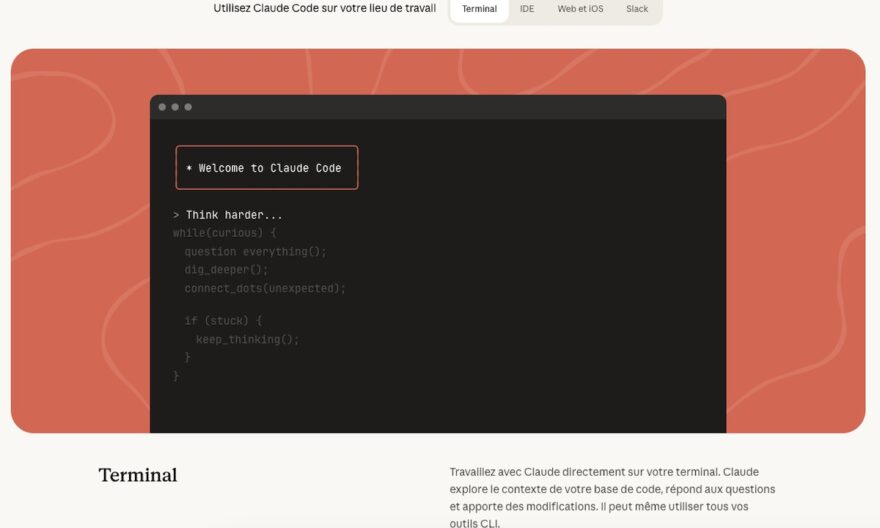

- Die Claude-App von Anthropic hat es geschafft, ChatGPT und Gemini im App Store zu übertreffen, insbesondere dank ihrer Fähigkeit, komplexe Aufgaben zu bewältigen.

- Ein menschlicher Fehler führte zum Leck des Quellcodes von Claude Code, wodurch entscheidende Informationen über das Projektmanagement des Tools enthüllt wurden.

- Obwohl dieses Leck nicht die KI-Modelle selbst enthält, legt es Sicherheitsmechanismen offen und erhöht das Risiko von Hackerangriffen.

Anthropic und der Aufstieg von Claude

Anthropic, das lange im Schatten anderer KI-Giganten stand, hat kürzlich dank seiner Anwendung Claude einen bemerkenswerten Durchbruch erzielt. Speziell für die Bearbeitung komplexer Aufgaben entwickelt, gewann Claude schnell an Popularität und übertraf Tools wie ChatGPT und Gemini. Dieser Aufstieg ist größtenteils auf die Veröffentlichung der Version Opus 4.6 zurückzuführen, die einen Wendepunkt in der Effizienz der Anwendung markierte.

Auswirkungen des Claude Code-Lecks

Die unerwartete Enthüllung des Quellcodes von Claude Code ist das Ergebnis eines einfachen menschlichen Fehlers bei einem npm-Registry-Update. Eine für das interne Debugging bestimmte Datei wurde versehentlich öffentlich gemacht, was die Möglichkeit bot, den gesamten Code zu rekonstruieren. Dieses Leck, obwohl es nicht das Gehirn der KI enthält, offenbart dennoch viele Geheimnisse über ihre Funktionsweise.

Folgen für die Sicherheit und den Wettbewerb

Das Leck des Claude Code-Codes bleibt nicht ohne Folgen. Es offenbart insbesondere die Sicherheitsmechanismen des Tools und öffnet die Tür für Hackerangriffe, die darauf abzielen, diese Schwachstellen auszunutzen. Für Anthropic, dessen Einnahmen zu einem großen Teil von diesem Tool abhängen, stellt die Situation eine große Herausforderung dar. Gleichzeitig könnten Konkurrenten von diesen Informationen profitieren, um ihre eigenen Lösungen zu verbessern.

Die Zukunft von Open-Source-Modellen inspiriert von Claude

Da der Code nun verfügbar ist, haben Entwickler auf Plattformen wie Reddit bereits begonnen, sich davon inspirieren zu lassen, um Open-Source-Versionen zu erstellen. Obwohl dieses Phänomen die Verfügbarkeit fortschrittlicher Technologien erhöhen könnte, wirft es auch Fragen zur Nachhaltigkeit des Vorsprungs von Anthropic auf. Der wahre Test für das Unternehmen wird darin bestehen, trotz dieser Offenlegung an der Spitze der Innovation zu bleiben.

Die Herausforderungen der Sicherheit in der KI

Das Leck von Claude Code wirft ein Licht auf ein wiederkehrendes Problem im Bereich der künstlichen Intelligenz: die Sicherheit von Quellcodes. Unternehmen müssen ihre Anstrengungen verdoppeln, um ihre Innovationen vor versehentlichen Lecks und böswilligen Angriffen zu schützen. In Zukunft wird die Sicherheit von Daten und Algorithmen entscheidend sein, um die Nachhaltigkeit und das Vertrauen in KI-Technologien zu gewährleisten.